聯系我們

全國咨詢熱線:189-2648-5166電話:0755-23012751

郵箱:960661316@qq.comQQ:960661316

地址:深圳市寶安區沙井街道馬鞍山第二工業區6棟

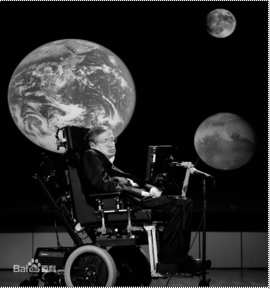

北京時間2018年3月14日下午,英國著名物理學家霍金遺憾辭世。享年76歲。霍金 史蒂芬·威廉·霍金(Stephen William Hawking),1942年1月8日出生于英國牛津,是英國劍橋大學著名物理學家,現代最偉大的物理學家之一。他的著有時間簡史等書,曾提出著名的黑洞理論。

不幸的消息傳來,世界各地紛紛表示哀悼,為霍金先生送上偉大的敬意。霍金先生為人類后續發展而持續對人工智能發聲。作為人類科技界僅存的瑰寶,我們雖然無法評價霍金先生的人工智能是否控制人類是否會實現,但是深感敬佩,霍金先生一生都在為人類的發展殫精竭慮,他一生都以推動人類發展為己任,知道辭世的那一刻。作為科技新聞報道的一員,小編在這里獻上最大的敬意。

霍金先生曾警告人類,不要過度開發人工智能,不然會給人類造成無法挽回的影響;而作為新聞行業地從事人員,我不竟想,怎么正視好霍金先生給我們的警告?人工智能不發展已經不可能,那可不可以通過技術手段,在人工智能發展的早期,限制它朝不利于人類發展的方向發展的腳步?

針對這個問題,我采訪了一家從事智能家居家用智能門鎖行業的從事人員。他是深圳一家叫做皇迪的專門研發和生產家用智能鎖的廠家的研發工程師。他表示道,目前,智能鎖業內也有意引導智能鎖行業朝完全的人工智能化發展。針對這個問題,業內也有討論,但是還是討論繼續從完全人工智能化的方向發展商業智能鎖、家用智能鎖。向他們家主要涉及家用智能鎖、家用彩屏智能鎖的方面;在發展完全智能鎖行業方向有所制衡主流方向。而智能鎖包括智能家居行業也有討論。

國內某手機廠家就曾表示,人工智能的發展是人為的科技,在技術上是做到提前的控制的,而這種技術上的限制就要靠整個行業的共識,沒有共識,人工智能就會朝不可預控的方向危險發展,畢竟誰也不敢保證世界上是否科學家為了獲取名利而不擇手段的研發新科技;但是如果業內有人工智能危害的共識,一起起草和制定行業規范和入門準則,人工智能反控制人類的情況就不會發生。

而深圳這家專門研發制造家用智能門鎖的皇迪廠家研發人員對上述意見和建議表示認同:人工智能不是洪水猛獸,就算是懸在人類頭頂的達摩力斯之劍,控制好了反而成為人類發展的有效工具也不一定。

而隨著霍金先生的辭世,人工智能的話題還將被熱烈討論。關于人工智能如何使用這個艱難的問題,相信人類一定可以找出最有效的辦法利用好他。那一天,也無所謂人工智能的爭論,而是人工智能怎么幫助人類更美好的生活。